LLM的有趣技术

https://www.bilibili.com/video/BV1gEcmzzE4P/

语言模型的进化

多模态

大语言模型是如何将所有的感官,对齐到语言系统中的?

这本质上属于多模态对齐(multimodal alignment)与表征学习(representation learning)的交叉问题。可以从结构层面+训练机制+对齐目标三个维度来精确理解。

人类的感官数据在原始形态上完全是异构的,所以核心问题变成,如何把连续的信号映射到一恶搞可以被语言模型理解的符号空间。

现代多模态大模型(如 GPT-4o、Gemini、Claude 等)通常采用如下结构:

不同模态编码器 → 统一 embedding 空间 → LLM(语言核心)每种感官都有专属编码器,比如图像的Vit,音频的wav2vec,视频的时空tranformer,文本的token embedding。

这些编码器的目标都是抓成一个高维语义向量。

那么如何对其到共享语义空间?

对比学习

对比学习:Contrastive learning 代表作为CLIP。训练目标:图像embedding=描述该图像的文本。

即最大化:

- 正样本(匹配图文)的相似度

- 负样本(不匹配)的距离

结果图像和语言落在同一个语义空间中

跨模态生成

Generative Alignment

图像 → 文本(captioning)

音频 → 文本(ASR)

视频 → 文本(描述)

训练方式

输入:图像 embedding

目标:生成对应文本 token

让 LLM 学会“用语言解释感官”

联合训练

直接训练一个模型处理:

[图像 tokens] + [文本 tokens] → 预测下一个 token

把非语言模态“token化”(tokenization of modalities)

语义一致性

最终目标不是“数据形式一致”,而是:不同模态表达相同“意义”时,其内部表示接近

- 一张猫的图片

- “a cat sitting on a sofa”

在 embedding 空间中应接近

为什么语言成为“中心模态”?

语言有几个决定性优势可以表达复杂结构:

- 时间

- 因果

- 抽象概念

标注成本最低:图像/音频的语义通常通过语言标注获得

LLM 的核心能力:

- chain-of-thought

- planning

- abstraction

都发生在语言空间。

语言不是被对齐的对象,而是“语义坐标系”

所有感官数据都被投影到这个坐标系中。

换句话说:

- 图像 ≠ 变成文字

- 图像 → 映射到“可以用语言解释的语义空间”

思维连

chain-of+thought。本质是让模型在给出最终答案之前,显式或隐式的生成中间推理步骤,从而提升复杂任务的正确率。

传统语言模型直接输出答案,COT是在输出和最终答案中增加了思考步骤。模型被引导像人一样一步步想。

可以将一个复杂的问题,拆成多个简单的子问题。

在训练或推理是。没有CoT只有最终loss,有CoT:每一步都有结构化的模式。本质上相当于在token级别上引入推理轨迹约束。

CoT 提示过程是一种最近开发的提示方法,它鼓励大语言模型解释其推理过程。思维链的主要思想是通过向大语言模型展示一些少量的 exapmles,在样例中解释推理过程,大语言模型在回答提示时也会显示推理过程。这种推理的解释往往会引导出更准确的结果。

零样本思维链(Zero Shot Chain of Thought,Zero-shot-CoT)提示过程是对 CoT prompting 的后续研究,引入了一种非常简单的零样本提示。他们发现,通过在问题的结尾附加“Let's think step by step”这几个词,大语言模型能够生成一个回答问题的思维链。从这个思维链中,他们能够提取更准确的答案。

外部工具

ReAct 和 Toolformer 是两种典型的“让模型使用工具/外部能力”的方法论,但它们的设计哲学和实现路径差异很大

ReAct

ReAct = 推理(Reasoning)+ 行动(Acting)交替进行

模型在推理过程中,不只是“想”,还会:

- 显式生成思考链(Thought)

- 决定调用工具(Action)

- 接收工具返回结果(Observation)

- 再继续推理

本质:把推理过程外显,并嵌入工具调用

显式推理链(Chain-of-Thought)

- 类似 CoT,但更进一步

- 推理过程中可以“打断去查资料”

- 动态工具调用

- 工具使用是 runtime 决策

- 不需要提前训练工具调用能力

- 强交互性

适合:

- 多步推理(multi-hop QA)

- agent系统

- 复杂决策任务

Toolformer

Toolformer = 让模型自己学会什么时候调用工具

和 ReAct 最大区别:

- ReAct:靠 prompt 引导

- Toolformer:靠训练学出来

Toolformer 做了三件关键事:

- 自监督生成工具调用数据

给模型少量 seed examples,然后:

模型自动:

- 在文本中插入 API 调用(如 calculator, search)

- 比较调用前后 loss

- 如果调用让预测更好 → 保留

自动构造训练数据!

- 训练模型

用这些数据 finetune,让模型学会:

- 何时调用工具

- 如何调用

- 如何利用返回结果

- 推理时自动调用

最终模型:

- 不需要 ReAct prompt

- 自然生成类似:

The result is [Calculator(23*45)] = 1035支持的工具类型(原论文)

- Calculator

- Search API

- Translation

- QA systems

既然有眼镜,草稿纸,计算器等工具了。LLM很像一个活生生的人。因此可以说小龙虾的火爆是必然的。

scaling law

1980s网页的增长速度鳗鱼存储系统的增长速度。我们有朝一日可以存下互联网上所有的数据。所以我们有了google。因此google的出现是必然的。

人类的智能不过是算力而已。象棋中,机器每多搜一层胜率就会提高一点。

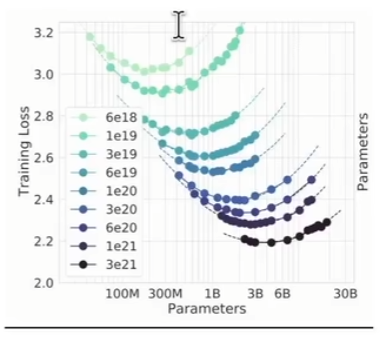

每一条曲线都是一个颜色固定一个算力。随着算力的增加,就需要越来越多的数据来喂饱它。纵轴是next token的loss

openai在训练150b模型的时候,没人知道openai是否能成功,当时openai只是做了小规模的验证。

一切都是历史的必然:Transformer在长上下文的能力上比LSTM的能力要好很多。所以Transformer活下来了。但是没有人知道是否存在一个模型能够用更少的参数训练出更号好模型的结构。

The bitter lesson中提到

心智的实际内容是极其复杂且无法简化的;我们应当停止试图寻找思考心智内容的简单方式,例如思考空间、物体、多重主体或对称性的简单方法。所有这些都是任意的、本质上复杂的外部世界的一部分。它们不应该是内建(预设)的,因为它们的复杂性是无穷无尽的;相反,我们应该只内建那些能够发现并捕捉这种任意复杂性的元方法。

使用AI

大模型是Transformer,prompt 工程实际上是attention工程(这就是为什么GPT刚出来的时候会有非常长的提示词。)没有合适的提示词LLM会倾向于车轱辘话(一部分是因为instruct fine-tuning/ RLHF)

提示词应该分解问题。也就是要构建一个合适的抽象。如何让大语言模型更好的工作,在如今就是如何让大语言模型更接近人类的工作方式。